V dnešnej dobe sa rozpoznávanie tváre už neobmedzuje iba na policajtov a špiónov v akčných filmoch. Mnoho používateľov smartfónov využíva túto technológiu na prihlásenie do svojho zariadenia každý deň, zatiaľ čo súvisiaci softvér sa používa aj na pasové kontroly na letiskách.

Vďaka rozpoznávaniu tváre bolo overenie totožnosti a prihlásenie do našich telefónov oveľa jednoduchšie. Niektorí ľudia sa však začali obávať, že iní môžu pre svoj softvér použiť svoje online obrázky.

Ak ste používateľom služby Flickr, vytvoril sa online nástroj, ktorý vám pomôže skontrolovať, či boli vaše obrázky použité na rozpoznávanie tváre. A ak áno, dá sa s tým niečo urobiť?

Prečo by sa moje online obrázky mali používať pre softvér na rozpoznávanie tváre?

Na vyskúšanie technológie rozpoznávania tváre potrebujú vývojári - dobre - tváre. Často vyberajú fotografie, ktoré boli zverejnené online, aby zistili, či ich technológia funguje alebo nie.

Rozpoznanie tváre si vyžaduje zlepšenie, aby sa našlo veľa rôznych tvárí. Berie sa do úvahy pohlavie, farba pleti, vek a ďalšie vlastnosti.

Ako webová stránka na zdieľanie fotografií je Flickr jasným cieľom pre spoločnosti a profesionálov, ktorí hľadajú fotografie. V roku 2019 sa všeobecne uvádzalo, že spoločnosť IBM použila fotografie z Flickru na výcvikové programy rozpoznávania tváre.

Spoločnosť chcela použiť rozmanitú škálu tvárí na zlepšenie problémov s rozpoznávaním tváre súvisiacich so zaujatosťou. Ľudia na obrázkoch však neboli kontaktovaní, aby zistili, či je použitie ich obrázkov v poriadku.

Súvisiace: Ako vyhľadávanie pomocou rozpoznávania tváre ničí vaše súkromie

V článku zverejnila NBC, jeden fotograf s obrázkami v databáze povedal:

„Nikto z ľudí, ktorých som fotografoval, netušil, že ich obrázky sa používajú týmto spôsobom.“ Zdá sa byť trochu povrchné, že IBM môže tieto obrázky použiť bez toho, aby niekomu niečo povedala. “

Problémy s rozpoznávaním tváre

Rasové zaujatie bolo veľkým bodom rozhovoru pre rozpoznávanie tváre. Uskutočnili sa štúdie s cieľom podrobnejšie preskúmať túto otázku, vrátane štúdií publikovaných v roku 2020 do roku 2006 Harvardská univerzita.

V štúdii mali ľudia popisovaní ako „tmavšia žena“ najnižšiu úroveň presnosti, pokiaľ ide o rozpoznávanie tváre u každého poskytovateľa.

Výskum sa zameral aj na históriu rasistických politík presadzovania práva v USA a na to, ako by technológie mohli spôsobiť ich pokračovanie.

Spoločnosť IBM tieto obavy vyjadrila sama. V roku 2020 spoločnosť vytiahol trhu rozpoznávania tváre. Generálny riaditeľ Arvind Krišna vtedy napísal verejný list Kongresu.

V liste sa požadoval „národný dialóg o tom, či a ako by mali technológie na rozpoznávanie tváre používať domáce orgány činné v trestnom konaní“.

IBM tiež uviedla:

„IBM sa dôrazne stavia proti a nebude tolerovať použitie žiadnej technológie vrátane technológie rozpoznávania tváre ponúkanej inými dodávateľmi na hromadné sledovanie, rasové profilovanie, porušovanie základných ľudských práv a slobôd alebo akýkoľvek účel, ktorý nie je v súlade s našimi hodnotami a zásadami dôvery a transparentnosť. “

Ako môžem skontrolovať, či boli moje fotografie použité?

Ak máte účet Flickr, môžete použiť nástroj s názvom vystavovať.ai.

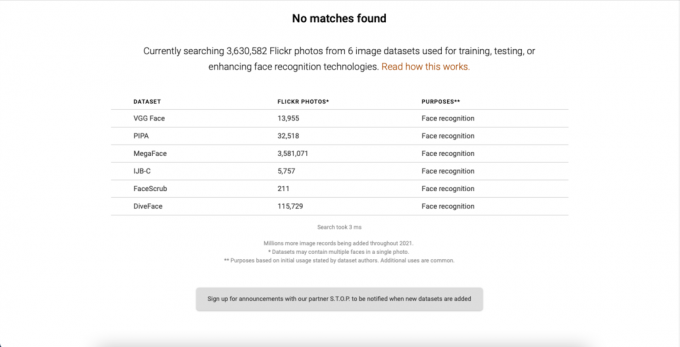

Exposing.ai prehľadáva viac ako tri milióny fotografií na serveri Flickr, ktoré sa šíria v šiestich rôznych súboroch údajov. Na tejto platforme môžete zistiť, či boli vaše obrázky použité na rôzne účely, napríklad:

- Posilnenie technológie rozpoznávania tváre

- Školenie

- Testovanie

Ak chcete skontrolovať, či boli vaše fotografie použité na softvér na rozpoznávanie tváre, navštívte web expose.ai. Na domovskej stránke sa v hornej časti zobrazí vyhľadávací priestor.

V tomto vyhľadávacom priestore môžete zadať ktorúkoľvek z nasledujúcich možností:

- Vaše používateľské meno na Flickr

- Hashtag

- Adresa URL fotografie

Po zadaní podrobností a klepnutí na tlačidlo Hľadať zistíte, či boli vaše fotografie použité do niekoľkých sekúnd.

Je niečo, čo môžem urobiť, ak boli moje fotografie použité na rozpoznanie tváre?

Nie z väčšej časti, nie. Ak je vaša tvár už v otvorenom rozsahu v množine údajov, nemôžete ju odstrániť.

Súvisiace: Je rozpoznávanie tváre legálne vo vašej krajine?

To isté však môžete zabrániť v budúcnosti, ak budete požadovať, aby váš obrázok nebol distribuovaný v ďalších vydaniach.

Napríklad fotografie, ktoré použila spoločnosť IBM, boli pôvodne súčasťou YFCC100M. Tieto fotografie boli zverejnené online ako súčasť licencie Creative Commons. Ak okrem niekoľkých výnimiek môžu byť použité ľubovoľne.

Bola vaša tvár použitá na rozpoznanie tváre?

Mnoho ľudí nechce, aby sa ich tváre na stránkach sociálnych médií vyznačovali, natož aby sa používali na výskum. Softvér na rozpoznávanie tváre sa síce musí zlepšovať, ale je tiež pochopiteľné, že niektorí používatelia nebudú chcieť, aby ich tváre boli distribuované bez súhlasu.

Aj keď toho veľa nemôžete urobiť, ak vaša tvár už bola použitá v súbore údajov, program exhibing.ai pomáha ukázať taktiku umelej inteligencie spoločností.

Všetko, čo momentálne môžete urobiť, je prečítať si o právach na zdieľanie obrázkov pred zverejnením na ľubovoľnej platforme. Okrem toho si budete musieť počkať na regulačné zmeny, aby sa podobné veci nestali.

Rozpoznávanie tváre sa stáva čoraz väčšou obavou o súkromie. Ako sa môžete vyhnúť sledovaniu a reklamám na rozpoznávanie tváre?

Prečítajte si Ďalej

- Sociálne médiá

- Bezpečnosť

- Ochrana osobných údajov online

- Flickr

- Rozpoznávanie tváre

Danny píše od tej doby, keď vo veku 10 rokov publikoval báseň na vnútroštátnej úrovni v rodnej Británii. Teraz má sídlo v dánskej Kodani a je tiež vášnivým fotografom.

Prihlásiť sa ku odberu noviniek

Pripojte sa k nášmu bulletinu s technickými tipmi, recenziami, bezplatnými elektronickými knihami a exkluzívnymi ponukami!

Ešte jeden krok…!

V e-maile, ktorý sme vám práve poslali, potvrďte svoju e-mailovú adresu.